模型十 聚类模型

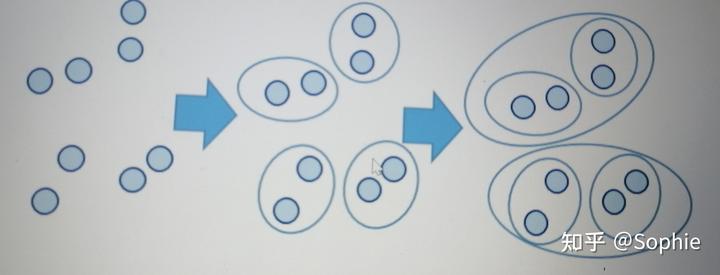

一、含义聚类,就是将样本划分为由类似的对象组成的多个类的过程。聚类后,可以更加准确的在每个类中单独使用统计模型进行估计、分析

一、含义

聚类,就是将样本划分为由类似的对象组成的多个类的过程。聚类后,可以更加准确的在每个类中单独使用统计模型进行估计、分析或预测;也可以探究不同类之间的相关性和主要差异。分类是已知类别的,聚类未知。

二、算法

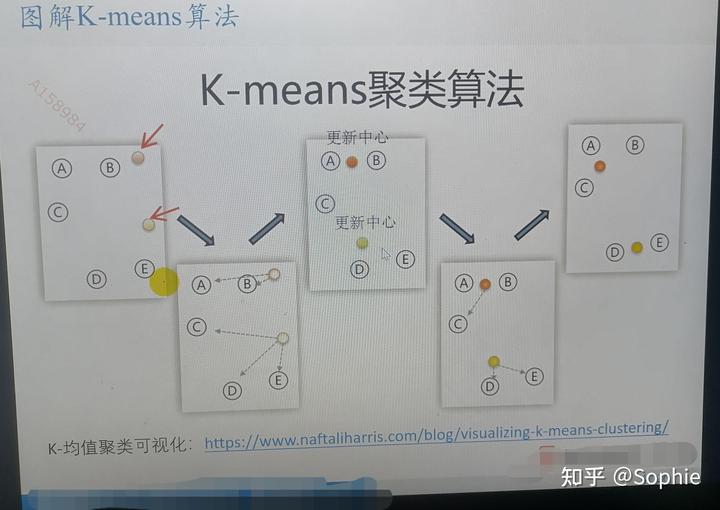

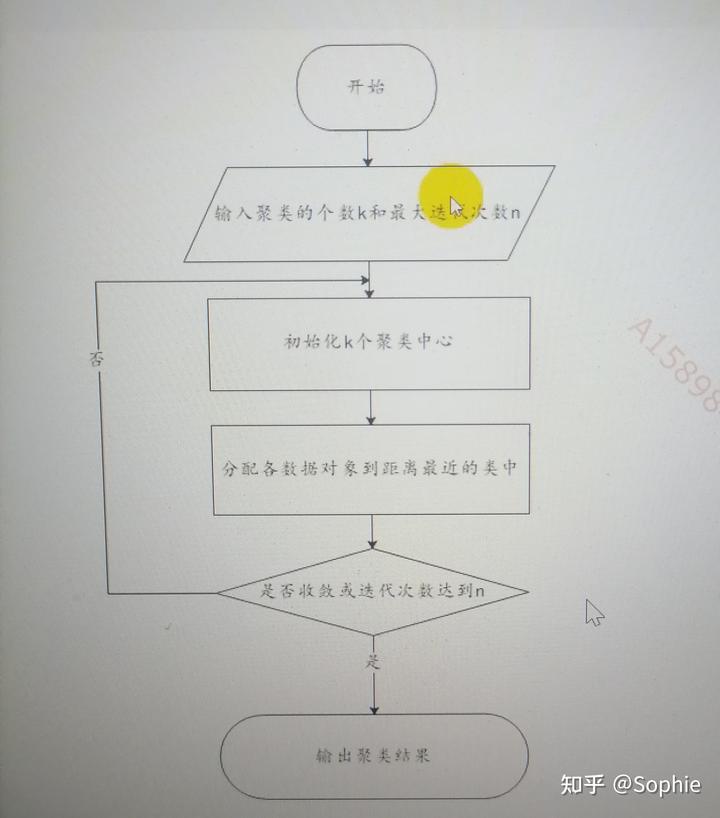

K - means 聚类的算法流程:

一、指定需要划分的簇[ cu ]的个数 K 值(类的个数);

二、随机地选择 K 个数据对象作为初始的聚类中心(不一定要是我们的样本点);

三、计算其余的各个数据对象到这 K 个初始聚类中心的距离,把数据对象划归到距离它最近的那个中心所处在的簇类中;

四、调整新类并且重新计算出新类的中心;

五、循环步骤三和四,看中心是否收敛(不变),如果收敛或达到迭代次数则停止循环;

六、结束。

在论文中可以画图表示步骤

三、算法评价

优点:

(1)算法简单、快速。

(2)对处理大数据集,该算法是相对高效率的。

缺点:

(1)要求用户必须事先给出要生成的簇的数目 k 。(2)对初值敏感。

(3)对于孤立点数据敏感。

K - means ++算法可解决2、3两个缺点。

四、K - means ++算法

k - means ++算法选择初始聚类中心的基本原则是:初始的聚类中心之间的相互距离要尽可能的远。

算法描述如下:

(只对 K - means 算法"初始化 K 个聚类中心"这一步进行了优化)

步骤一:随机选取一个样本作为第一个聚类中心;

步骤二:计算每个样本与当前已有聚类中心的最短距离(即与最近一个聚类中心的距离),这个值越大,表示被选取作为聚类中心的概率较大;最后,用轮盘法(依据概率大小来进行抽选)选出下一个聚类中心;

步骤三:重复步骤二,直到选出 K 个聚类中心。选出初始点后,就继续使用标准的 K - means 算法了。

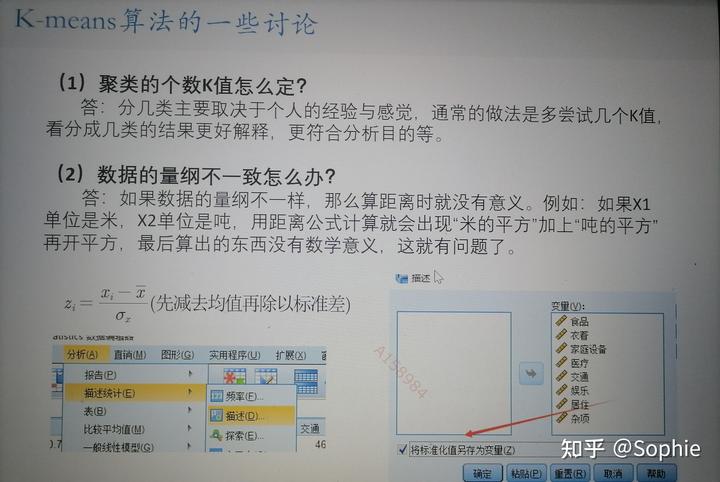

五、常见问题

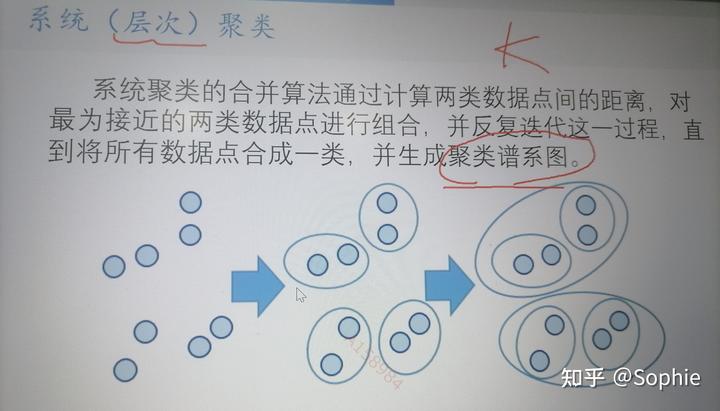

六、系统(层次)聚类

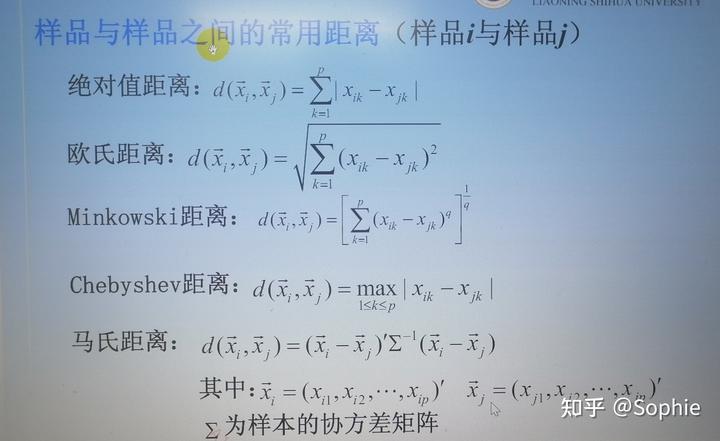

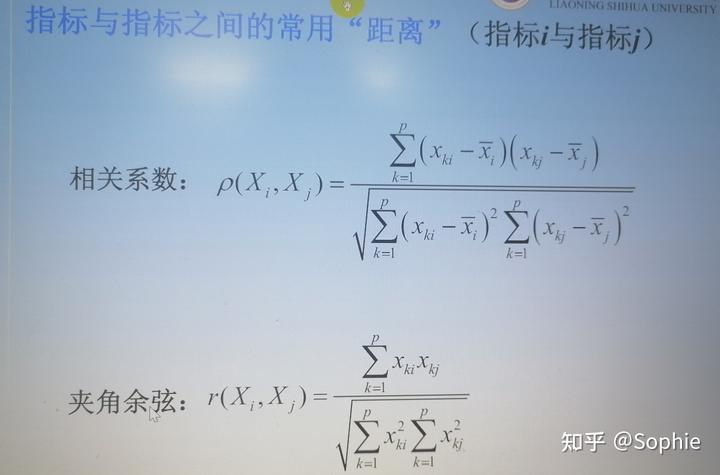

聚类的原则:距离近的样本聚为一类

绝对值距离:适用于网状道路

欧式距离:运用最广泛,是Minkowskim距离的一个特例。

切比雪夫距离:运用十分少

马氏距离:用的少

如果有网状道路,用绝对值距离,其他一般用欧式距离。

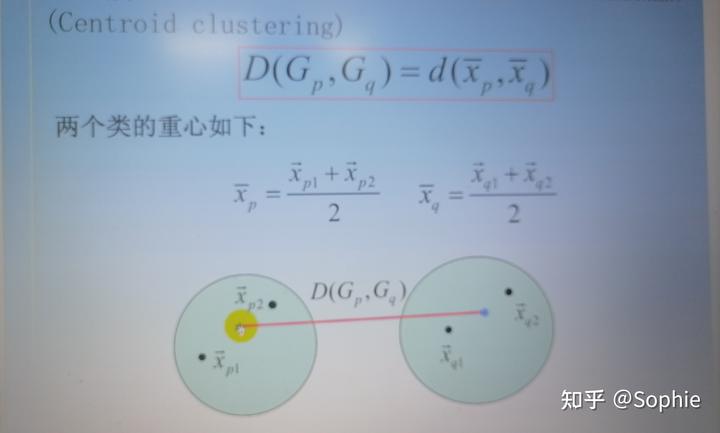

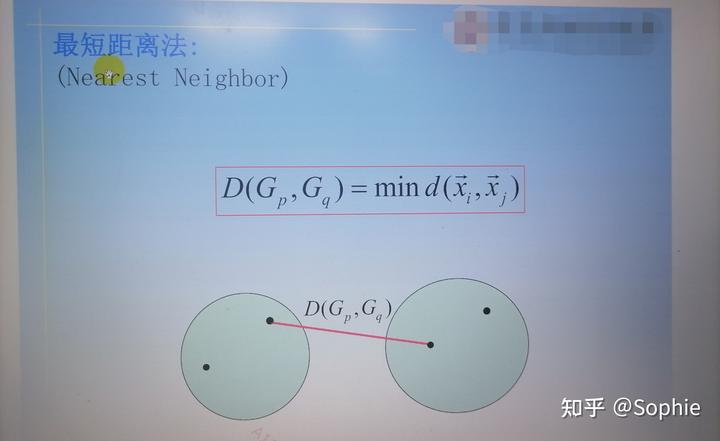

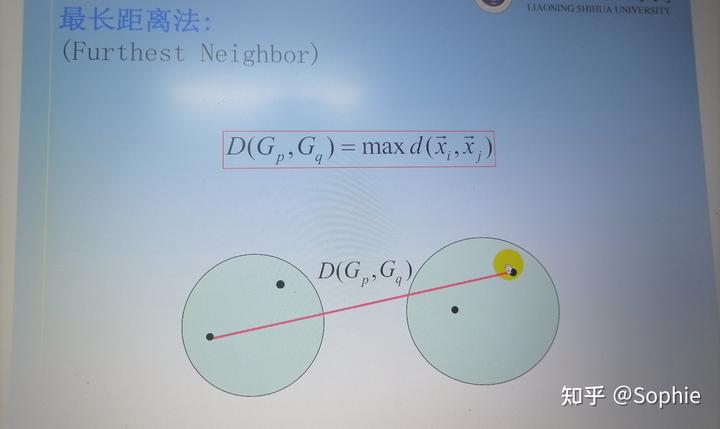

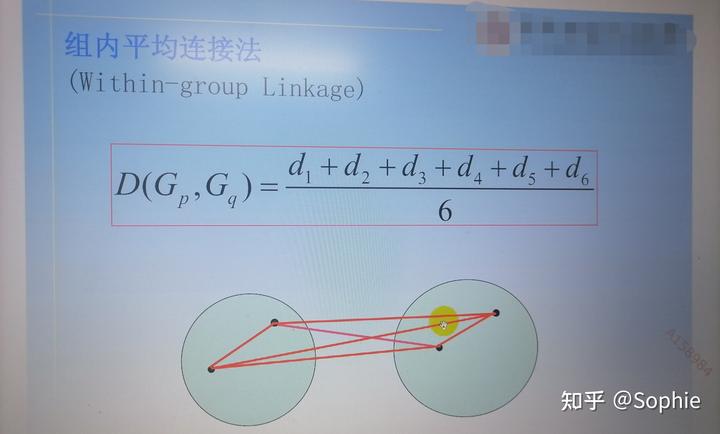

组内平均法和组间平均分用的较多。聚类的方法多种多样,只要能解释出结果就行。

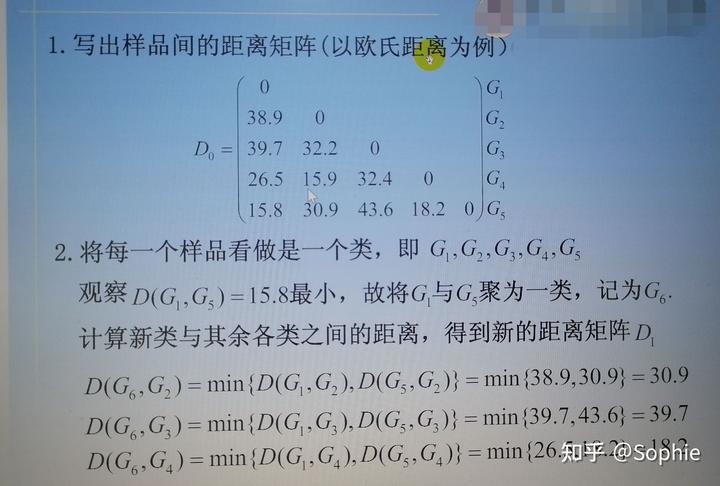

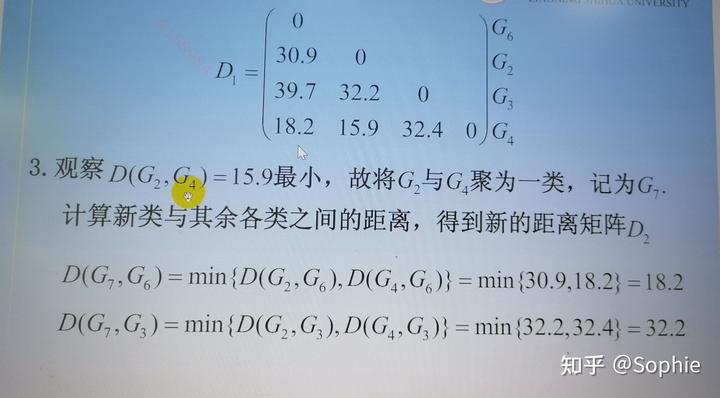

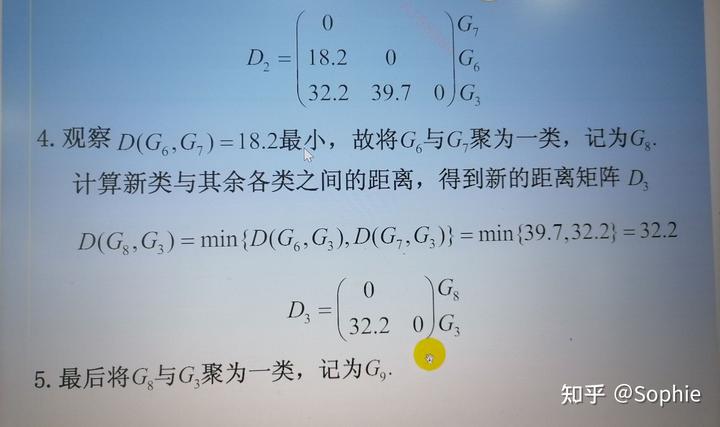

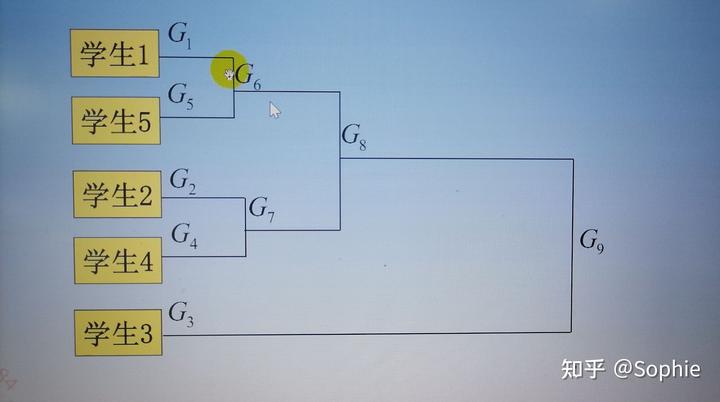

七、系统聚类的一个例子(以最短距离法为例)

八、系统聚类需要注意的问题

1.对于一个实际问题要根据分类的目的来选取指标,指标选取的不同,分类结果一般也不同。

2.样品间距离定义方式的不同,聚类结果一般也不同。

3.聚类方法的不同,聚类结果一般也不同(尤其是样品特别多的时候)。最好能通过各种方法找出其中的共性。

4.要注意指标的量纲,量纲差别太大会导致聚类结果不合理。

5.聚类分析的结果可能不令人满意,因为我们所做的是一个数学的处理,对于结果我们要找到一个合理的解释。

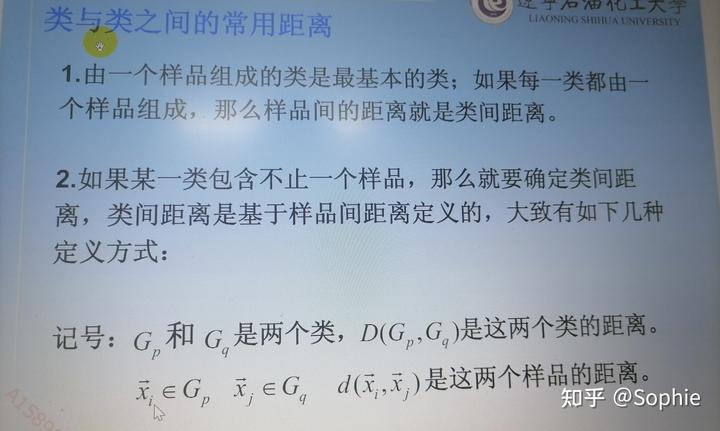

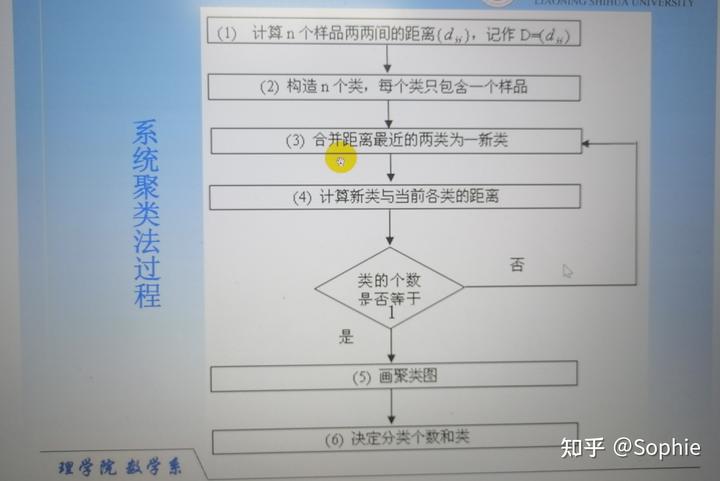

九、系统聚类算法流程

一、将每个对象看作一类,计算两两之间的最小距离;

二、将距离最小的两个类合并成一个新类;

三、重新计算新类与所有类之间的距离;

四、重复二三两步,直到所有类最后合并成一类;

五、结束。

在spass运行中,为了方便解释,最好k≤5

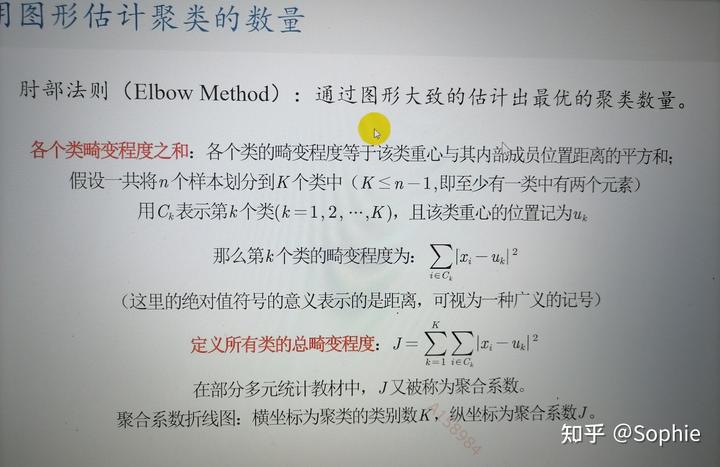

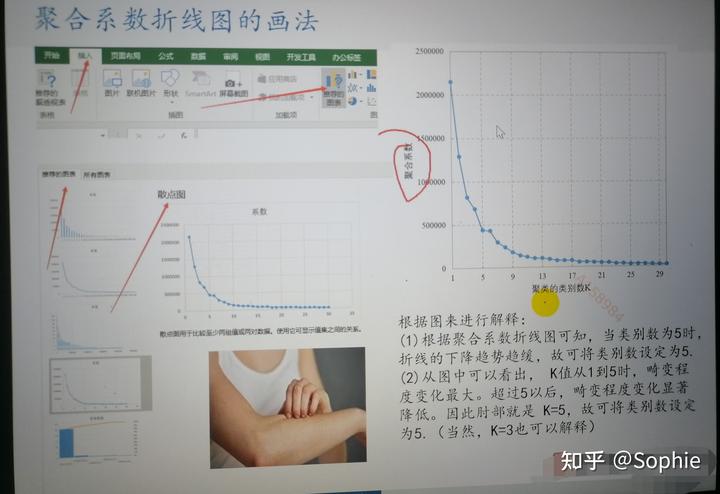

十、系统聚类中如何确定k的数量——肘部法则

k越大,J(聚合系数越小),所以聚合系数折线图是递减的。

十一、DBSCAN算法

DBSCAN ( Density - based spatial clustering of applications with noise )(具有噪声的基于密度的聚类算法)是 Martin Ester , Hans - PeterKriegel 等人于1996年提出的一种基于密度的聚类方法,聚类前不需要预先指定聚类的个数,生成的簇的个数不定(和数据有关)。该算法利用基于密度的聚类的概念,即要求聚类空间中的一定区域内所包含对象(点或其他空间对象)的数目不小于某一给定阈值。该方法能在具有噪声的空间数据库中发现任意形状的簇,可将密度足够大的相邻区域连接,能有效处理异常数据。

K-means聚类算法和系统聚类算法是基于距离,而DBSCAN是基于密度

1.基本概念

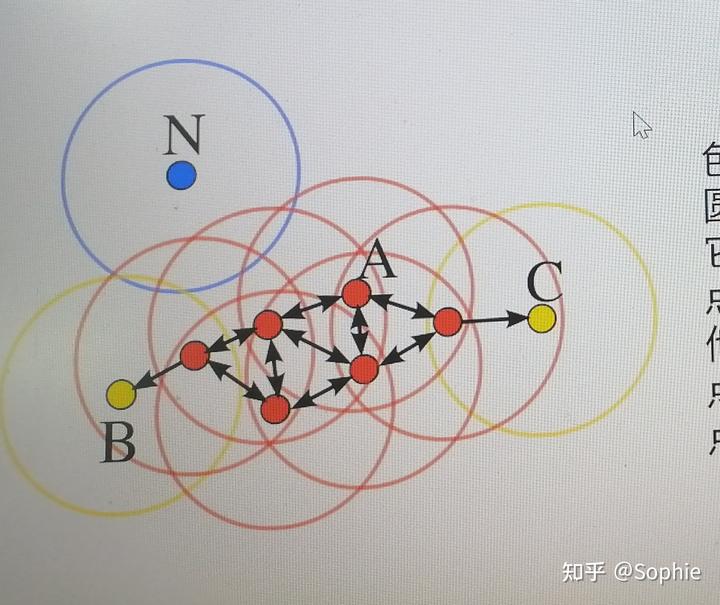

DBSCAN 算法将数据点分为三类:

·核心点:在半径 Eps 内含有不少于 MinPts 数目的点

.边界点:在半径 Eps 内点的数量小于 MinPts ,但是落在核心点的邻域内

·噪音点:既不是核心点也不是边界点的点

在这幅图里, MinPts =4,点 A 和其他红色点是核心点,因为它们的 邻域(图中红色圆圈)里包含最少4个点(包括自己),由于它们之间相互相可达,它们形成了一个聚类。点 B 和点 C 不是核心点,但它们可由 A 经其他核心点可达,所以也和 A 属于同一个聚类。点 N 是局外点,它既不是核心点,又不由其他点可达。

2.实现过程

Matlab 代码

Matlab 官网推荐下载的代码:

https://ww2.mathworks.cn/matlabcentral/fileexchange/52905-dbscan-clustering-algorithm

% Copyright ( c )2015, Yarpiz (http://www.yarpiz.com)

% All rights reserved . Please read the " license . txt " for license terms .

%

% Project Code :YPML110

% Project Title : Implementation of DBSCAN Clustering in MATLAB % Publisher : Yarpiz (http://www.yarpiz.com)

%

% Developer : S . Mostapha Kalami Heris ( Member of Yarpiz Team )%

% Contact Info:sm.kalami@gmail.com,info@yarpiz.com

3.优缺点

优点:

1.基于密度定义,能处理任意形状和大小的簇;

2.可在聚类的同时发现异常点;

3.与 K - means 比较起来,不需要输入要划分的聚类个数。

缺点:

1.对输入参数 E 和 Minpts 敏感,确定参数困难;

2.由于 DBSCAN 算法中,变量和 Minpts 是全局唯一的,当聚类的密度不均匀时,聚类距离相差很大时,聚类质量差;

3.当数据量大时,计算密度单元的计算复杂度大。

建议:

只有两个指标,且你做出散点图后发现数据表现得很" DBSCAN ",这时候你再用 DNSCAN 进行聚类。

其他情况下,全部使用系统聚类吧。

K - means 也可以用,不过用了的话你论文上可写的东西比较少。